Le 23 juin la NASA a informé le public que le rover Curiosity avait relevé dans le cratère Gale la plus forte émission de méthane jamais constatée sur Mars. Cette information est surprenante et importante mais il ne faut pas en tirer de conclusion hâtive.

Tout d’abord il faut placer cette émission dans un contexte. La proportion de méthane (CH4) constatée a été de 21 « ppbv » (parties par milliard en volume). Les plus fortes émissions précédentes, également mesurées par Curiosity (plus précisément par le « TLS », Tunable Laser Spectrometer, de son laboratoire embarqué « SAM », Sample At Mars) ont été de 7,2 ppbv mais sur la durée, le fond d’émissions est inférieur à 1 ppbv (entre 0,2 et 0,7). Surtout, le maximum enregistré n’est « rien » par rapport aux proportions de méthane présent dans l’atmosphère terrestre (1750 ppbv en moyenne) et cette dernière est beaucoup plus dense (plus de 100 fois) que l’atmosphère martienne. Il faut donc relativiser mais ce n’est pas facile de « garder la tête froide » car le méthane est un gaz au contenu évocateur très fort. Sur Terre il est pour sa plus grande part (plus de 90%) le produit de la vie animale (rejet métabolique résultant de la fermentation des molécules organiques dans le système digestif des animaux et généralement parlant, de l’activité microbienne dans les milieux anoxiques).

L’histoire de la détection du méthane sur Mars est pour le moins déconcertante et défie encore l’entendement. Cela a commencé entre 1999 et 2003 par des observations à partir des télescopes terrestres qui ont indiqué une proportion allant de 20 à 30 ppbv (mais l’observation depuis la Terre est difficile car la signature spectroscopique du méthane se déplace en fonction du déplacement de Mars sur son orbite et parce que les rayonnements reçus par ces télescopes passent par l’atmosphère terrestre elle-même chargée en méthane). Cela a continué en 2009 par la constatation que la présence du gaz dans l’atmosphère suivait un cycle saisonnier (disparaissant en fin d’automne et réapparaissant en fin de printemps) alors qu’il aurait dû se diluer dans l’atmosphère et subsister pendant quelques 340 ans (destruction progressive par le rayonnement ultraviolet). Ensuite on a observé dans le cratère Gale les émissions relativement fortes de fin 2013 (quatre pics atteignant les environs de 7 ppbv) puis on est retombé à des niveaux extrêmement faibles (moins de 1 ppbv). Lorsque l’orbiteur TGO (ExoMars Trace Gas Orbiter) de l’ESA (lancé en Octobre 2016) est devenu opérationnel en avril 2018, il n’a d’ailleurs rien perçu alors qu’il avait été en partie prévu pour la détection des gaz rares et principalement le méthane, au point que certains ont considéré que les premières observations résultaient d’une erreur d’interprétation des données spectrographiques. Puis soudainement on a ce nouveau pic annoncé par la NASA, supérieur à 20 ppbv…littéralement sans lendemain puisque le lundi 24 le taux était retombé à moins de 1 ppbv !

Les causes des émissions de méthane martien ne sont pas connues et cette nouvelle observation ne nous fait pas progresser mais on peut cerner les possibilités à partir de ce qui se passe (ou s’est passé) sur Terre. Ces possibilités sont soit d’ordre géologique soit d’ordre biologique avec pour les deux une variante possible résultant d’un « effet retard ». De toute façon il s’agit de l’union de carbone provenant du gaz carbonique avec de l’hydrogène, donc de « molécules organiques ».

Les causes géologiques peuvent être d’abord la serpentinisation de l’olivine, roche magmatique très ancienne, riche en magnésium et en fer (mafique) et très abondante en surface de Mars depuis l’aube des temps. La transformation de l’olivine en serpentine ((Mg, Fe, Ni)3Si2O5(OH)4) au contact d’eau chaude et sous forte pression, libère des carbonates, de l’hématite (Fe3O4) et de l’hydrogène. A son tour l’hydrogène peut s’allier au gaz carbonique atmosphérique pour former en présence de fer (par exemple de l’hématite) du méthane. A noter que cette dernière réaction est la fameuse « réaction de Sabatier » que Robert Zubrin a recommandé d’utiliser pour produire sur Mars le carburant nécessaire pour faire revenir sur Terre les vaisseaux spatiaux qu’on y enverra. Quoi qu’il en soit du futur de ce gaz, l’abondance d’olivine, de gaz carbonique et de chaleur (dans des régions de failles comme Nili Fossae) pourrait très bien être à l’origine du méthane martien. Ceci dit, à côté de la serpentinisation de l’olivine il y a d’autres causes géologiques possibles mettant en jeu la chaleur du sous-sol, l’hydrogène de l’eau et le gaz carbonique de l’atmosphère. C’est le volcanisme par contact de remontées magmatiques avec de la glace de surface ou proche de la surface ou sa variante, le thermalisme. Marginalement ce pourrait être aussi l’apport de météorites riches en méthane. Toutes ces causes ne sont d’ailleurs pas exclusives.

Pour ce qui est de la cause biologique, on peut toujours, jusqu’à preuve du contraire, penser à une population microbienne en sous-sol de Mars. Elle serait visiblement peu active mais ses rejets métaboliques auraient à l’occasion de mouvements sismiques accès à la surface de la planète.

Le facteur « retard » évoqué plus haut pourrait être vu comme un déblocage de méthane accumulé dans des clathrates. Les clathrates sont de petites capsules de glace d’eau emprisonnant des molécules de gaz, le tout constituant un « hydrate de méthane ». Elles se forment sous basse température, en présence d’eau et sous forte pression. Sur Terre on en constate souvent la présence dans le pergélisol (jusqu’à 1000 mètres de profondeur) et ces sols sont très fréquents en surface de Mars, planète froide. Ils fondent (sur Mars, se subliment) évidemment par exposition à la chaleur. Ce peut être celle du Soleil lors de l’été austral ou encore celle de remontées magmatiques parvenant en dessous de failles s’ouvrant en surface de la planète. Et on a justement repéré dès 2003 les failles de la région de Nili Fossae, en bordure d’Isidis Planitia, comme une des principales sources des émissions de méthane.

Mars 2020 (mission NASA) doit se poser tout près de ces failles. Capter et analyser le méthane dans l’atmosphère de cette région sera probablement plus facile car tout près du sol on devrait pouvoir constater une abondance beaucoup plus forte que dans le cratère Gale. Ce sera aussi passionnant…Pour distinguer l’éventuel origine (biologique ou géologique) du gaz il faudra rechercher le rapport entre les isotopes 13 et 12 des atomes de carbone (13C ou 12C). En effet, comme on l’a constaté depuis longtemps la vie recherche l’économie de masse et privilégie donc les atomes légers (et stables), en l’occurrence l’isotope 12 du carbone (12 neutrons dans le noyau). Il n’y a aucune raison que la vie martienne si elle existe ne suive pas la même « politique de bon sens ». Nous aurons donc une réponse mais peut-être l’aurons-nous sans attendre 2021 car le laboratoire SAM de Curiosity devrait normalement pouvoir effectuer lui aussi des analyses isotopiques.

Il faut à l’occasion de cet article dire que ce n’est pas que l’apparition du méthane qui pose problème mais aussi que sa disparition rapide et constante n’est pas non plus expliquée. Pour le moment aucune raison ne peut être donnée pour cette efficacité. Peut-être les sels de perchlorates, omniprésents, chauffés par le rayonnement solaire oxydent-ils ce gaz en méthanol puis en formaldéhyde ? Peut-être est-ce l’action des champs électriques résultant de l’ionisation du gaz carbonique de l’atmosphère, très sèche, par les frottements des particules de poussière en suspension ?

Pour le moment on constate et on ne peut rien dire sauf que la planète produit bien du méthane et que le mystère qui l’entoure est périodiquement ravivé.

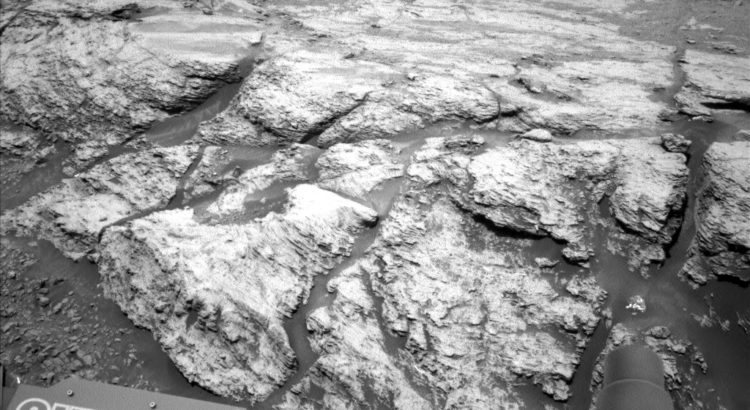

Image de titre : Teal Ridge dans les Clay Bearing Units ; photo du 18 juin, Crédit NASA/JPL-CalTech. Les Clay Bearing Units avaient été repérées depuis l’espace par les orbiteurs martiens. Leur abondance dans le cratère Gale ont en grande partie justifié le choix du site de la mission MSL (Curiosity).

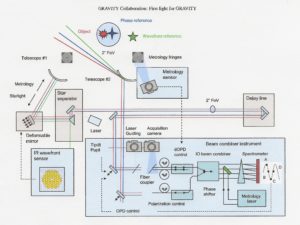

Photo ci-dessous, les différents modes de formation possible du méthane sur Mars. Crédit NASA/JPL-CalTech:

Pour (re)trouver dans ce blog un autre article sur un sujet qui vous intéresse, cliquez sur: