Ces dernières semaines une nouvelle concernant l’astronomie a largement circulé dans les médias, celle de la réception par les « grandes oreilles » de nos observatoires, de « sursauts-radio-rapides » ou « FRB » (« Fast Radio Burst »). Comme à l’accoutumé quand une nouvelle concerne l’espace, beaucoup de Terriens restés fortement anthropocentrés, ont voulu y voir des messages que s’échangeraient entre elles d’autres civilisations, évidemment supérieures mais quand même comparables à la nôtre. Il n’en est rien mais ces émissions perçues depuis peu (la première observation, par David Narkevic* date de 2007) et toujours mal expliquées le sont maintenant un peu plus et elles sont fort intéressantes en elles-mêmes et utiles pour comprendre notre Univers. De quoi s’agit-il ?

*David Narkevic était membre de l’équipe dirigée par Duncan Lorimer, professeur de physique et d’astronomie au Centre des ondes gravitationnelles et de cosmologie de l’Université de Virginie Occidentale. Les FRB sont aussi appelés « sursauts Lorimer ».

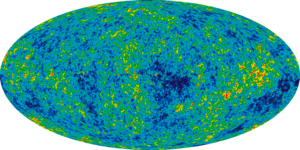

La petite centaine de FRB répertoriés à ce jour sont des émissions photoniques dans des longueurs d’ondes radio du spectre électromagnétique. Ils ne durent que quelques millisecondes. Il faut bien avoir conscience que les FRB ne sont pas les seuls événements dont l’existence nous est signifiée par un message cosmique très bref. Nous recevons en effet des signaux tout aussi furtifs sous forme d’autres rayonnements qui sont soit dans d’autres longueurs d’ondes du spectre électromagnétique (rayons X, rayons gamma, flash lumineux), soit émis par d’autres « messagers » (neutrinos, ondes gravitationnelles, rayons cosmiques et notamment particules à très haute énergie). Par chance, contrairement à d’autres rayonnements électromagnétiques de longueurs d’ondes plus courtes ou plus longues, ceux qui nous intéressent ici, les SHF (pour « Supra-Haute Fréquence », longueurs d’ondes allant d’environ 0,8 à 10 cm et de fréquences allant d’environ 1 à 30 gigahertz), parviennent jusqu’à la surface de la Terre sans trop de distorsions (mais elles sont très utilisées par l’homme ce qui peut les brouiller !). La durée d’un FRB est probablement fonction de la surface de la source. Celle du premier (FRB121102, observé par David Narkevic), qui a duré 10 millisecondes, indique que la source était toute petite, seulement 3000 km de diamètre, donc très puissante. Ce FRB comme les suivants, était par ailleurs caractérisé par une forte dispersion, c’est-à-dire un fort décalage temporel des diverses fréquences constituant le rayonnement, et une certaine torsion des rayonnements. Une émission n’est en effet évidemment pas constituée d’une seule fréquence et plus faible est la fréquence (longueur d’ondes élevée), plus les ondes porteuses de la fréquence peuvent être ralenties par le milieu spatial s’il y a « quelque chose » dans ce milieu spatial. Or, précisément, le « vide » comprend (entre autres, sans prendre en considération les particules virtuelles ou la matière noire, toujours hypothétique) des électrons libres et des noyaux d’atomes divers, à commencer par des protons, tous éléments ionisés qui se comportent comme un plasma du fait de la vitesse du rayonnement (la densité est accentuée par la quasi simultanéité des « rencontres » du fait de la vitesse et malgré la rareté). La dispersion et la torsion sont donc des indicateurs de la distance et une forte dispersion et torsion, indiquent une origine lointaine. Compte tenu du « redshift » (effet Doppler-Fizeau) du spectre des rayonnements reçus on a pu estimer les sources de FRB identifiées à plusieurs milliards d’années-lumière.

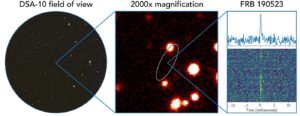

Le fait que nous n’ayons remarqué à ce jour que peu de FRB ne veut pas dire qu’ils ne soient pas fréquents (on les estime à un millier par jour). Il faut plutôt envisager que nous n’avions pas jusqu’à présent les moyens techniques de les percevoir. Il faut en effet disposer d’un récepteur d’ondes radio focalisé sur le point du ciel d’où ils proviennent, précisément au moment où ils arrivent sur Terre (un large champ est évidemment utile pour ne pas « manquer » le signal), et collecter en même temps un autre message (ou avoir collecté suffisamment d’informations lors d’une première observation) de la même source (lumineux si possible) pour croiser l’information. Dans le cas du FRB190523 l’étude a pu être poursuivie par l’instrument LRIS (Low Resolution Imaging Spectrometer) de l’Observatoire Keck. Le récepteur focalisé ce sont les systèmes radio interférométriques comme celui de l’ASKAP en Australie (« Australian Square Kilometer Array Pathfinder »), dispositif comprenant 36 antennes ou le « DSA-10 » d’« OVRO » (« Deep Synoptic Array prototype » de l’« Owen Valley Radio Observatory », en Californie) qui est dédié à cette recherche mais ne dispose actuellement encore que de 10 antennes ou aussi le télescope CHIME, du Canada, très particulier, dont je vous parlerai bientôt. C’est avec le DSA-110 que l’on a perçu tout récemment le dernier FRB (FRB190523, cf revue Nature du 2 Juillet 2019). NB : le prototype, opérationnel depuis juin 2017, sera étendu à un dispositif de 110 antennes (« DSA 110 ») d’ici à deux ans et un jour peut-être à un DSA-2000. Selon Vikram Ravi (Caltech/UC Berkeley) le découvreur de ce dernier FRB, la puissance de résolution doit atteindre l’équivalent d’une antenne physique d’un diamètre de 1609 mètres (un mile) pour être efficace (il faut donc un minimum d’antennes et si on dispose de plus, c’est mieux). Tous ces systèmes interférométriques (y compris ALMA qui est utilisé plutôt dans les longueurs d’ondes millimétriques) sont relativement nouveaux car leur développement suppose une puissance informatique qui émerge actuellement et il faut aussi que les systèmes soient attentifs et immédiatement réactifs à des événements très discrets.

On parvient donc à capter de plus en plus de ces FRB mais on a encore beaucoup de mal à identifier leurs sources (la précision de la position requise est de l’ordre du 1/1000 de degré sur la voûte céleste). En fait on n’a pu le faire que trois fois (pour les FRB121102, FRB 180924 et FRB190523). FRB 121102 est une galaxie petite et active (qualifié de telle pour sa production abondante d’étoiles) située à 3 milliards d’années-lumière ; FRB 180924 est une galaxie « grosse et calme » à 4 milliards d’années-lumière; FRB 190523 une autre galaxie « grosse et calme » située à 7,9 milliards d’années-lumière. Ce qui a justifié l’émoi médiatique récent c’est que précisément on a pu, grâce à l’ASKAP, identifier la source de FRB180924, ce qui a donné lieu à un beau « document de recherche » (« research paper », voir lien ci-dessous) de K.W Bannister et al. (Australie). Il a été suivi une semaine après, par un autre document (voir lien ci-dessous) de Vikram Ravi et al. qui propose également une source pour FRB190523 (observée le 13 mai 2019). Pour comprendre un signal la connaissance et donc d’abord le repérage de la source est essentiel. Ce qui est remarquable et « ouvre des horizons », c’est que FRB180924 et FRB190523 sont des événements uniques (ils ne se sont exprimés qu’une seule fois) alors que le FRB121102 est une multiplicité d’événements provenant d’une même source, c’est-à-dire que la même source a émis plusieurs fois un signal (mais de façon non périodique). Cette différence sous-entend que les causes des FRB pourraient entrer dans des catégories différentes. Les restes extrêmement condensés de supernovæ sont de bons candidats pour les FRB multiples (FRB121102, plus petite que la Voie-Lactée produit plus d’étoiles qu’elle). Pour les FRB uniques, il semble que les galaxies sources soient beaucoup plus massives, et peu actives. Une explication réconciliant les deux, serait dans les deux cas des étoiles à neutrons mais dans des environnements différents : l’effondrement récent d’une étoile massive qui donne un magnétar (éruption de plasma d’une étoile à neutrons jeune et hautement magnétique) ou deux étoiles à neutrons anciennes dans un système binaire quand la distance orbitale entre elles se réduit.

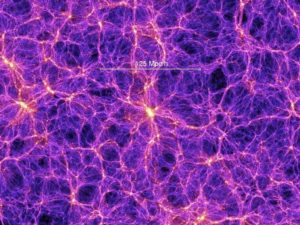

L’intérêt de ces signaux comme le disent K.W Banister et al. c’est aussi (surtout ?) qu’ils peuvent nous permettre du fait de leur dispersion et de leur torsion, d’être informés des milieux qu’ils traversent. Un des grands problèmes de la cosmologie actuelle c’est en effet que la matière baryonique ne constitue que 4% de l’énergie que comprend l’univers et que seulement 10% en est fourni par les gaz froids et les étoiles des galaxies. On cherche le « reste », des atomes de métal mélangés à l’hydrogène et à l’hélium résultat de l’explosion d’étoiles ou de noyaux galactiques actifs. Une partie (30%?), le « CGM », « Circum-Galactic Medium » doit être un plasma diffus autour des galaxies (leur “halo”) et une autre partie (60%?), l’« IGM », « Medium Intergalactique », doit flotter entre les galaxies. Par ailleurs la magnétisation même faible mais sur une très longue durée provoque une torsion (« effet Faraday ») des différentes fréquences du rayonnement et cela aussi est porteur d’informations. Les flashs radios que nous recevons d’un peu partout dans l’univers pourront donc nous renseigner sur la densité et la magnétisation de ce plasma et « rien que » cela apporterait une pièce importante au puzzle que nous essayons d’assembler.

La « science des FRB » est donc une discipline nouvelle. Il faudra pour mieux les connaître disposer de beaucoup plus d’observations (une centaine d’observations dont 3 identifications, ce n’est vraiment pas beaucoup !). Lorsqu’on aura ces observations on pourra mieux connaître les étoiles à neutrons mais on pourra aussi affiner la carte en 3D de la répartition des masses dans l’univers donc approcher de la compréhension de l’ensemble du système. Pour y parvenir, il y a déjà une capacité installée mais elle va s’étendre considérablement: le DSA-10 couvre 150 fois la surface de la Lune vue de la Terre et l’observatoire CHIME couvre un champ de vision instantané de 200° carré de la voûte céleste. Mais bientôt le DSA-110 puis le DSA-2000, tout comme le SKA, (Square Kilometer Array) successeur de l’ASKAP (ou plutôt qui intégrera l’ASKAP dans un ensemble mondial), donneront aux astronomes des capacités fantastiques par rapport à celles qui existent aujourd’hui.

De nos jours, il se passe toujours quelque chose de formidable en astronomie et l’ouverture d’une nouvelle fenêtre d’observations sur l’Univers vaut mieux que le bavardage insipide autour d’improbables petits hommes verts qui restent toujours un fantasme !

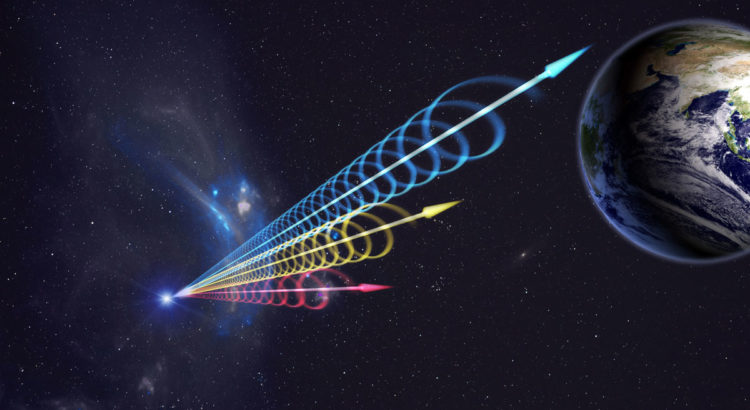

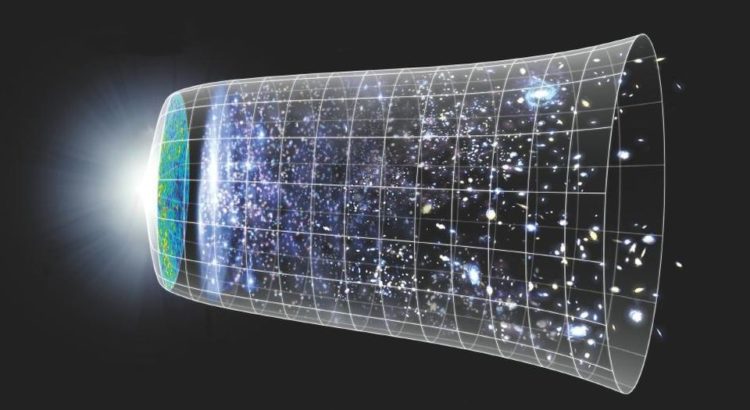

Image de titre : crédit Jingchuan Yu, Planétarium de Pékin. Les couleurs représentent le sursaut arrivant à différentes longueurs d’ondes (les plus longues, en rouge, arrivant plusieurs secondes après les plus courtes, bleues) en raison de la « dispersion » résultant de leur voyage au travers du plasma intergalactique. Vous remarquerez également la faible « torsion » (rotation) des rayonnements.

Image ci-dessous : Le prototype du Deep Synoptic Array (DSA-10) recherche les FRB dans une région de la voûte céleste de la taille de 150 fois la Lune (à gauche). Le DSA-10 peut localiser ces FRB avec une très haute résolution, les isolant jusqu’à une seule galaxie (au milieu). La photo à droite montre le profil du FRB, au-dessus de son spectre radio. Crédit : Caltech/OVRO/V.Ravi.

Liens:

https://www.nature.com/articles/d41586-019-02400-2

https://www.nature.com/articles/s41586-019-1389-7

https://public.nrao.edu/news/2015-gbt-frb/#PRimageSelected

Pour (re)trouver dans ce blog un autre article sur un sujet qui vous intéresse, cliquez sur: