Une enquête du New York Times publiée en janvier 2022[1] démontre que l’entreprise israélienne NSO Group, qui développe le logiciel d’espionnage Pegasus, ne le livre pas seulement aux démocraties occidentales mais également parfois à des régimes autoritaires peu fréquentables. Ce faisant, elle renverse les garde-fous qu’elle prétend encore ne pas franchir, dont celui de trier sur le volet les gouvernements demandeurs. Dans un article paru le 16 novembre 2022 dans +972 Magazine, un magazine indépendant qui réunit des journalistes palestiniens et israéliens, Tariq Kenney-Shawa semble craindre que la prise de liberté de NSO Group par rapport à ses principes lui aurait vraisemblablement fait vendre son logiciel au régime des mollahs iraniens[2]. Certes, il n’apporte aucune preuve irréfutable, ce qui serait bien difficile à faire, mais au vu des découvertes antérieures du New York Times, cela semble plutôt plausible. Et cela ne serait qu’un exemple parmi d’autres. Le Temps du 18 janvier 2023 mentionne en effet l’utilisation généreuse de la même application de surveillance par le pouvoir marocain, soupçonné d’ingérence au Parlement européen, au même titre que le Qatar[3].

Dans son article, Tariq Kenney-Shawa se pose la question de savoir si la révolte populaire en Iran a des chances significatives de renverser le régime des mollahs. Cet article est repris par Courrier international dans son édition du 15 décembre 2022 sous le titre « La révolte en Iran peut-elle réussir ? »[4]. Selon l’auteur, la victoire des révolutionnaires et des défenseurs des droits humains et des droits des femmes est loin d’être acquise. Son principal argument repose sur le fait que les régimes répressifs sont désormais mieux armés technologiquement pour exercer une répression féroce sur toute forme de mouvement révolutionnaire. Et le logiciel Pegasus fait précisément partie de cet arsenal d’un type nouveau. Il est d’ailleurs désormais considéré par Israël comme une arme au même titre que les drones, les fusils d’assaut ou les missiles[5].

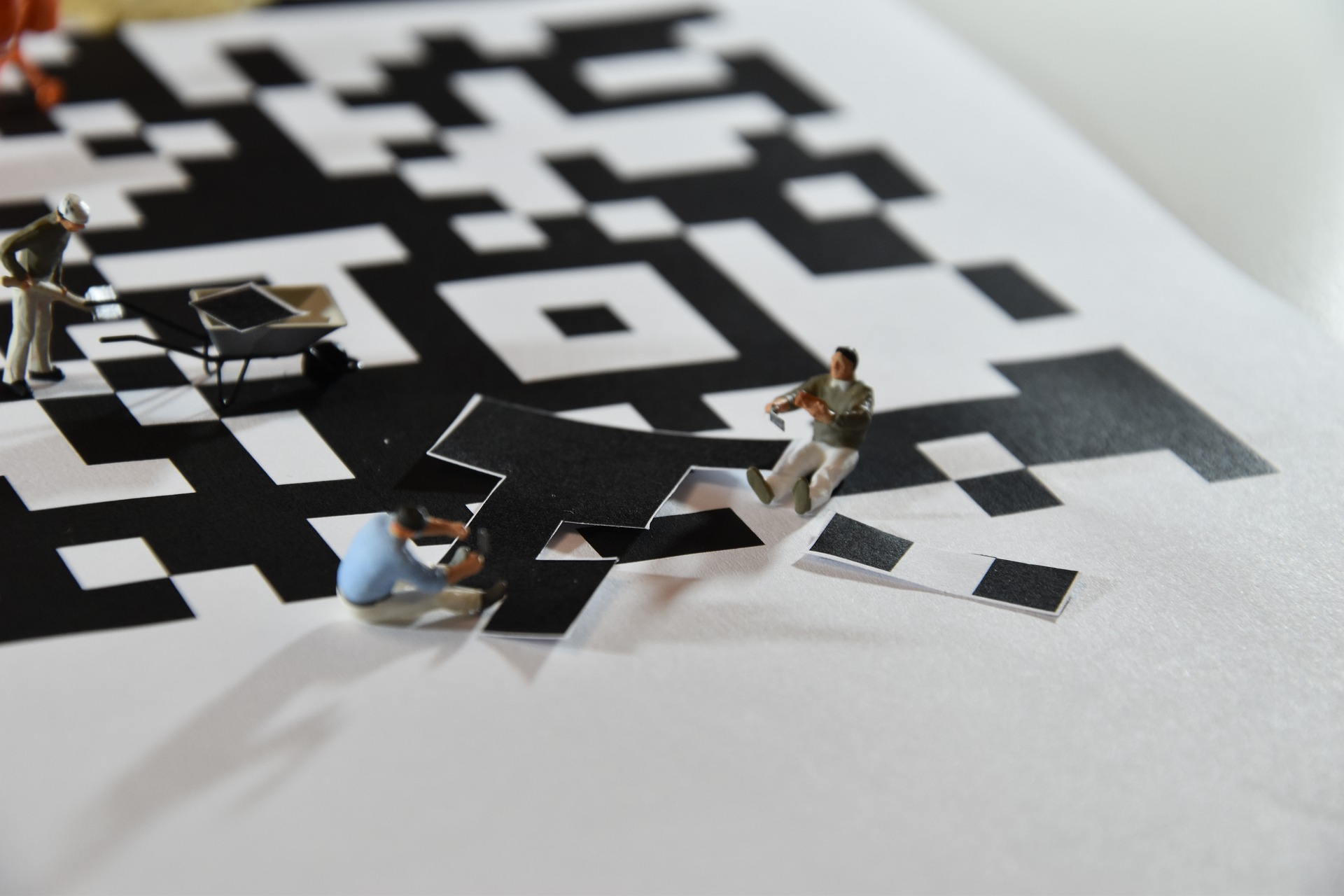

Pendant les printemps arabes de 2010-2012, on considérait que le peuple, par sa maîtrise des réseaux sociaux, comme Facebook ou Twitter, avait une longueur d’avance sur les régimes autoritaires qu’il visait à renverser. Les médias occidentaux s’en sont largement réjouis, qualifiant les réseaux sociaux de véritables outils de liberté. Les GAFAM devenaient en quelque sorte les grands héros de la démocratie. Las, aujourd’hui, toujours selon le journaliste du +972 Magazine, « les contestataires se battent désormais contre des régimes plus puissants, plus intelligents et mieux installés, qui ont su s’adapter aux méthodes modernes de résistance. Grâce à l’expérience accumulée au fil des ans, les despotes (…) se sont approprié les outils technologiques – dont beaucoup espéraient pourtant qu’ils permettraient de contourner la censure et de faciliter la mobilisation – pour exercer une surveillance stricte de la population (…). Grâce aux progrès des instruments de surveillance, les services de renseignement au Moyen-Orient sont désormais capables de s’infiltrer dans les moindres recoins de la société civile, ou presque. Il est devenu quasiment impossible de communiquer ou d’organiser des actions à l’insu d’un gouvernement ».

Un renversement de pouvoir dans la maîtrise du numérique

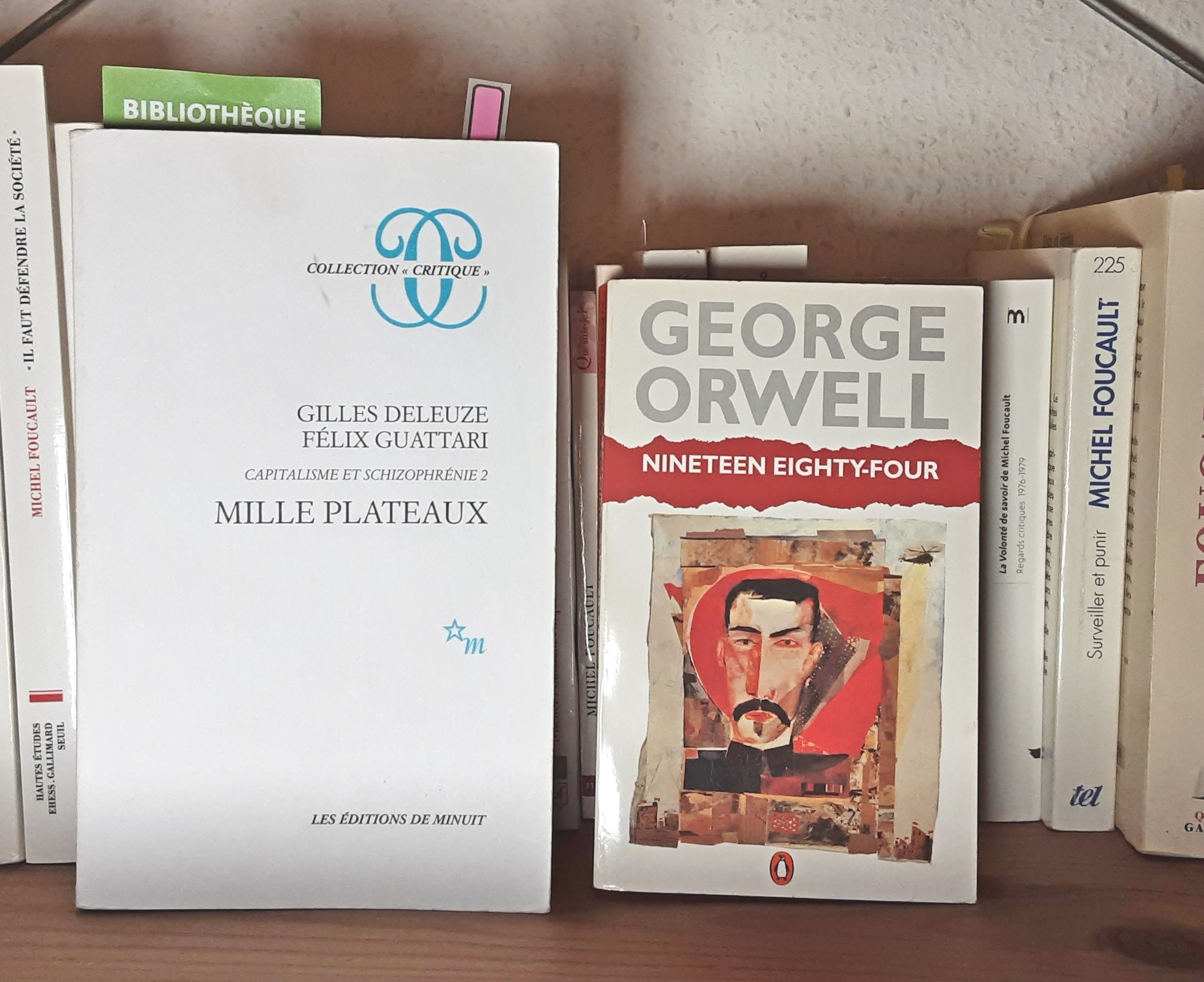

Aussi, comme dans la dystopie orwellienne 1984 où règne un tyran, Big Brother, qui observe tout le monde, les outils technologiques de surveillance redeviennent la propriété du pouvoir en place. Il n’y a plus de « surveillant surveillé », pour reprendre une formule populaire dans le champ des études sur la surveillance[6], et c’est surtout au renforcement du surveillant qu’on assiste. Or, la technologie phare utilisée ou convoitée par ces régimes, dont peut-être aussi le régime iranien, est précisément le logiciel Pegasus, qui aura défrayé la chronique lorsque journalistes et militants du monde entier ont découvert que leur téléphone portable était espionné sans qu’ils s’en doutent[7].

En effet, ce logiciel s’installe désormais sur un téléphone portable à l’insu total de l’utilisateur, sans même requérir la moindre action sur un message malveillant reçu, en exploitant des failles de sécurité des systèmes iOS et Android. Pour rappel, il permet d’espionner les messages de la victime, d’activer sa caméra ou son microphone, d’établir la liste de ses appels et de récolter toute forme d’information contenue et produite par les applications. Pegasus fait le bonheur des services de lutte contre le terrorisme, des services secrets, des polices nationales mais aussi, hélas, des régimes autoritaires. Même s’ils l’utilisent dans un premier temps à bon escient, certains gouvernements démocratiques ne résistent pas à la tentation d’utiliser le logiciel d’infiltration pour des causes moins nobles. C’est le cas du Mexique, qui est ainsi parvenu à arrêter le célèbre baron de la drogue El Chapo, mais a également utilisé cette nouvelle arme pour espionner des avocats défenseurs des droits de l’homme qui enquêtaient sur l’implication du gouvernement fédéral dans le massacre d’étudiants à Iguala en 2014[8]. Cela fait plus de 40 ans que cette pratique, baptisée « function creep[9] » et visant à détourner l’usage d’une technologie à des fins de surveillance est parfaitement documentée dans les études sur la surveillance. Ce sont précisément les dangers liés à ces détournements que ciblent prioritairement les lois sur la protection des données, dont la RGPD[10] européenne. Une banalisation de ces pratiques, enrichies par un mélange des données, entraînerait un glissement inéluctable vers une société de surveillance totale.

Dans le cas qui nous intéresse ici, on peut véritablement se demander pourquoi le gouvernement israélien et ses services secrets ne montrent pas une plus grande sévérité envers NSO Group, qui vend son logiciel à des régimes connus pour mener des politiques hostiles à Israël. On a vu des têtes tomber pour moins que cela. Les Etats-Unis, par exemple, n’ont pas épargné Assange ou Snowden, qui suivent pourtant une ligne éthique et des objectifs bien plus louables : la défense de la liberté et de la démocratie. Pourquoi ne sont-ils pas alors traités comme des défenseurs de ces principes fondamentaux ?

Pour Amnesty International, la vente extrêmement lucrative du logiciel Pegasus est hors de contrôle. Elle s’inscrit dans le cadre d’un « manque général de régulation qui a créé un véritable Far West dans lequel les militant·e·s et les journalistes sont pris pour cible de façon abusive et généralisée[11] ». Ce constat, publié en 2021 par l’organisation, laisse penser que les agissements de NSO Group ne seraient guidés que par leur cupidité. Selon la même organisation, rien n’a changé depuis lors. À l’été 2022, Amnesty International a dénoncé le fait que « les entreprises de surveillance continuent de tirer profit des violations des droits humains à l’échelle mondiale[12] ». Depuis 2021, les Etats-Unis ont même inscrit NSO Group, aux côtés d’une entreprise russe et d’une entreprise singapourienne, dans la liste des entreprises étrangères qui se livrent à des activités malveillantes, y compris à l’égard d’employés d’ambassades[13]. Dès lors, sommes-nous vraiment face à une situation devenue hors de contrôle ?

L’enquête du New York Times citée au début de cet article propose une autre analyse. Elle suggère que NSO Group et les pouvoirs israéliens travaillent en étroite collaboration. Pour le journal new-yorkais, le logiciel Pegasus représente une véritable opportunité qui permet à Israël de contourner l’appréhension des Etats-Unis de devoir partager des informations sensibles avec ses alliés, en ayant recours à des portes dérobées inconnues des autres pays clients, y compris des gouvernements occidentaux alliés. Dit plus simplement, en haut de la pyramide de l’espionnage, les clients de NSO Group pourraient bien être espionnés eux-mêmes par les services secrets israéliens. Cette possibilité, qui reste à prouver, suscite des craintes légitimes car elle n’est pas sans rappeler le scandale de la société suisse Crypto AG, qui, entre 1970 et 1993, a permis aux services secrets allemands et états-uniens d’accéder aux données des clients de son système de cryptage, soit plus d’une centaine d’Etats[14].

Les panelistes de la table ronde « Ethics of the Sale of Cyber and Intelligence Tools at the Offensive Realm », qui s’est tenue à Tel Aviv dans le cadre d’une conférence sur l’innovation technologique, abondent dans ce sens. S’interrogeant sur l’éthique en matière de vente d’outils cybernétiques et de renseignement, ils se sont dit convaincus que les entreprises concernées allaient continuer leurs ventes avec la bénédiction de l’Etat israélien[15]. Ainsi, il est raisonnable d’émettre l’hypothèse que par le biais d’une porte dérobée dans le logiciel Pegasus, les services secrets israéliens peuvent, avec une précision jamais atteinte, identifier et espionner les personnes cibles des régimes autoritaires, tout en ayant accès aux données personnelles de ces mêmes cibles. Voilà qui permettrait d’avoir un coup d’avance géostratégique extrêmement avantageux.

Quel avenir pour la démocratie dans le monde ?

En somme, est-ce vraiment le « Far West » du côté de NSO Group, qui ne serait guidé que par sa seule cupidité, comme le suggère Amnesty International ? Le logiciel est-il réellement vendu au plus offrant, sans distinction politique aucune ? Il est difficile de croire à un laisser-faire de la part du gouvernement israélien. Cela équivaudrait pour lui à se tirer une balle dans le pied, métaphore d’autant plus pertinente que Pegasus, on l’a vu plus haut, est désormais considéré comme étant une arme de guerre par le gouvernement israélien lui-même. La thèse défendue par le New York Times sur NSO Group semble plus plausible lorsque l’on se place sur l’échiquier géostratégique mondial. Si ces pratiques s’intensifient et se répandent, dans les régimes autoritaires comme dans les régimes occidentaux, faut-il alors craindre une mort lente de la démocratie ?

Essayons de nous rassurer un peu en puisant dans la littérature classique des sciences politiques. Pour Alexis de Tocqueville, grand théoricien et observateur de la démocratie, tout régime, aussi autocratique soit-il, tend irrémédiablement vers un éclatement des forces autoritaires pour s’ouvrir à la démocratie, comme attiré par une force gravitationnelle. Cela ne serait qu’une question de temps. Voilà la thèse ardemment défendue dans le premier tome de De la démocratie en Amérique[16], publié pour la première fois en 1835. L’auteur prend l’hésitation française et ses allers-retours entre la Révolution et la Restauration de l’Ancien régime comme exemple, en l’opposant à celui de l’Amérique qui s’est inscrite pour plus de deux siècles dans une démocratie relativement stable. L’antithèse est bien évidemment celle des écueils pratiquement inévitables de la démocratie, aujourd’hui rigoureusement exploités par l’extrême-droite et qui mènent potentiellement à sa destruction. S’il ne parle pas de l’extrême-droite, Alexis de Tocqueville partage déjà ses préoccupations quant à la fragilité de la démocratie dans le deuxième tome de De la démocratie en Amérique[17], paru cinq ans plus tard. Il s’inquiète de voir une population prise dans le piège d’une société de consommation qui finit par la rendre impassible face aux enjeux politiques contemporains. Placée dans une temporalité à plus long terme, et examinée avec un regard critique, peut-être que la contradiction de Tocqueville n’en est plus vraiment une. Il y aurait un temps pour une inéluctable démocratisation, suivi d’un temps pour sa destruction, puis sa reconstruction.

Ici et maintenant, on peut légitimement se demander si l’accès de gouvernements, démocratiques ou non, à une arme ultime d’espionnage va dans le sens d’une stabilisation de la démocratie ou si, au contraire, elle mène cette dernière à sa perte. Même dans le cas d’un régime démocratique, les analyses, dont celle du New York Times, tendent à montrer qu’il est difficile pour l’Etat détenteur de Pegasus de résister à la tentation d’outrepasser l’usage premier et officiel (par exemple, lutte contre le terrorisme ou le crime organisé) pour viser dans un deuxième temps des objectifs moins nobles, tels que l’espionnage de groupes potentiellement critiques envers le pouvoir.

Il est très dangereux de la part d’Israël de permettre aux régimes autoritaires, dont celui les mollahs si tel est le cas, de multiplier leur efficacité en matière de répression avec un logiciel espion, sous prétexte que cela peut leur donner un avantage stratégique en leur permettant d’espionner les espions sans que ces derniers le sachent. L’impression d’avoir ainsi peut-être un coup d’avance sur l’échiquier géostratégique international a un prix extrêmement élevé. En outre, sur les plans de l’éthique et des droits de l’homme, cette façon de procéder est parfaitement inadmissible. Espionner finement sa population pour exercer un contrôle insidieux sur lui, que cela soit par le biais d’une répression sanglante ou d’un contrôle subtil visant à pousser à la consommation ou à influencer des votes n’est jamais sain du point de vue démocratique. Il suffit de se rappeler le scandale de Cambridge Analytica, dont les agissements ont été révélés en détail par Christopher Wylie, un ingénieur qui travaillait pour cette société[18].

Seules doivent être tolérées des opérations fines destinées à lutter contre le terrorisme ou à déjouer l’espionnage d’un Etat ennemi ou ami. Ces exceptions sont prévues dans les lois sur la protection des données, telles que la loi suisse de protection des données et la fameuse RGPD européenne, qui montre hélas, malgré toute la bonne volonté des juristes et des parlementaires européens, de sérieux signes de faiblesse. Quoi qu’il en soit, il ne faut en aucun cas tolérer l’installation d’une situation de « Far West » de la surveillance et la création d’un « paradis des données », que ce soit pour un régime autoritaire ou démocratique ou pour une institution publique ou privée.

[1] https://www.nytimes.com/2022/01/28/magazine/nso-group-israel-spyware.html

[2] https://www.972mag.com/popular-uprisings-middle-east/

[3] https://www.letemps.ch/opinions/derriere-qatargate-maroc

[4] https://www.courrierinternational.com/article/analyse-la-revolte-en-iran-reussira-t-elle-a-conjurer-le-sort-du-printemps-arabe

[5] https://www.972mag.com/nso-surveillance-companies-israel-army/

[6] Pour une introduction de ce champ d’études, voir notamment : Marx, Gary T. Windows into the Soul: Surveillance and Society in an Age of High Technology. Chicago: The University of Chicago Press, 2016.

[7] https://www.lemonde.fr/projet-pegasus/article/2021/07/19/projet-pegasus-comment-la-societe-israelienne-nso-group-a-revolutionne-l-espionnage_6088692_6088648.html

[8] https://www.nytimes.com/2022/01/28/magazine/nso-group-israel-spyware.html

[9] Voir par exemple : Koops, Bert-Jaap. « The concept of function creep ». Law, Innovation and Technology 13, nᵒ 1 (2021): 29‑56.

[10] Le « règlement général sur la protection des données » : https://commission.europa.eu/law/law-topic/data-protection/data-protection-eu_fr

[11] https://www.amnesty.ch/fr/themes/surveillance/docs/2021/projet-pegasus-revelations-espionnage-grande-ampleur-logiciel-israelien-nso-group

[12] https://www.amnesty.ch/fr/themes/surveillance/docs/2022/pegasus-un-an-apres-la-crise-des-logiciels-espions-se-poursuit

[13] https://www.commerce.gov/news/press-releases/2021/11/commerce-adds-nso-group-and-other-foreign-companies-entity-list

[14] https://flypaper.ch/crypto-ag-a-espionne-depuis-la-suisse-elle-nest-pas-la-seule/

[15] https://www.972mag.com/nso-surveillance-companies-israel-army/

[16] Tocqueville, Alexis de. De la démocratie en Amérique, I. Folio. Histoire 12‑13. Paris: Gallimard, 1986.

[17] Tocqueville, Alexis de. De la démocratie en Amérique, II. Folio. Histoire 12‑13. Paris: Gallimard, 1986.

[18] Wylie, Christopher. Mindf*ck: Cambridge Analytica and the Plot to Break America. New York, 2019.